.jpg?updatedAt=1727350894819&tr=w-930,h-720)

Vorschau in:

Wie werden sie erstellt?

Social-Media-Spam zu erstellen ist einfach – alles, was man braucht, ist Übung und Stable Diffusion. Die Plattform von Stability.ai hat dank ihrer unglaublichen Technologie an Popularität gewonnen und ermöglicht es Nutzern, Bilder zu erstellen, die so realistisch sind, dass es schwer ist, sie von echten Fotos zu unterscheiden.

Natürlich können auch viele andere Tools wie DALL-E oder Playground AI verwendet werden, um Bilder zu generieren. Unabhängig vom Tool bleibt das Ziel dasselbe: Bilder zu erstellen, die so realistisch sind, dass das menschliche Auge sie nicht von echten Fotografien unterscheiden kann.

Die Probleme mit generativer KI

- Deepfakes und Desinformation: Gefälschte Bilder und Videos können verwendet werden, um Menschen zu betrügen, Desinformation zu verbreiten und Social-Media-Algorithmen zu manipulieren.

- Urheberrecht und geistiges Eigentum: Der Aufstieg von KI-generierter Kunst wirft Fragen zum Urheberrecht auf. Kann eine KI als Schöpfer ihrer Kreationen angesehen werden? Wie schützen wir die Rechte der Künstler, deren Werke zur Ausbildung dieser Modelle verwendet werden?

Über welche Art von Posts sprechen wir?

Haben Sie sie gesehen? Das ältere Paar, das Sie heute Morgen auf Facebook gesehen haben, könnte tatsächlich ein KI-generierter Betrug sein, der darauf abzielt, Kommentare zu sammeln. Während manche sagen, dass es hauptsächlich „Boomer“ sind, die auf diese Fälschungen hereinfallen, kann jeder getäuscht werden.

Unser Team hat sich eingehender mit den besten Beispielen dieser Manipulationen beschäftigt. Wir begannen unsere Suche auf Reddit, wo Nutzer diese Fälschungen erkennen und kritisieren.

Hier sind nur einige herausragende Beispiele:

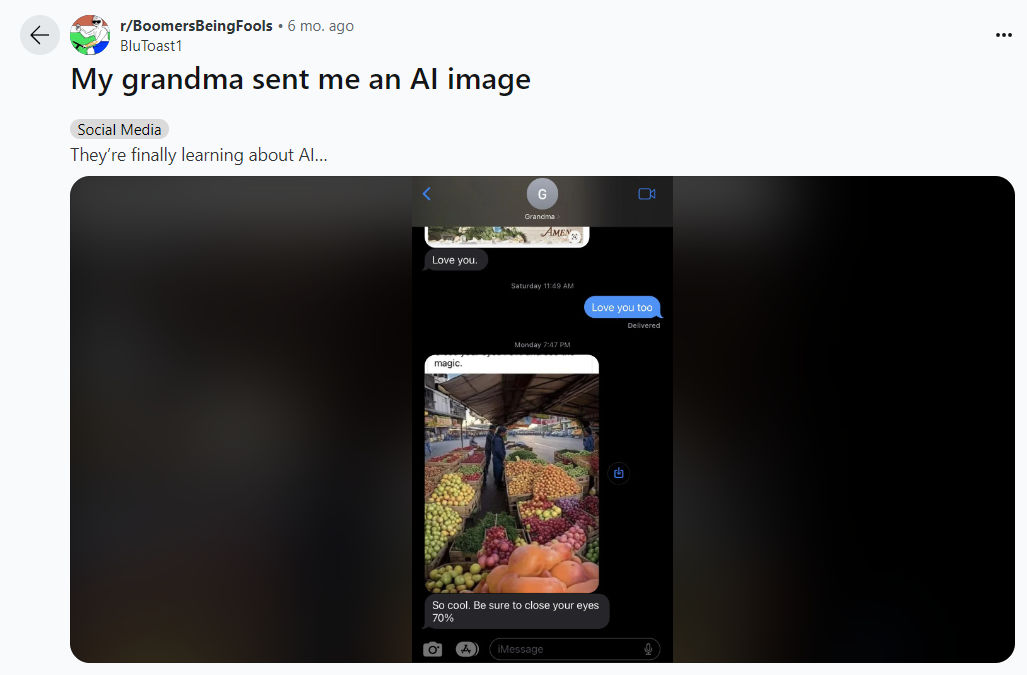

Geteilt auf r/BoomersBeingFools

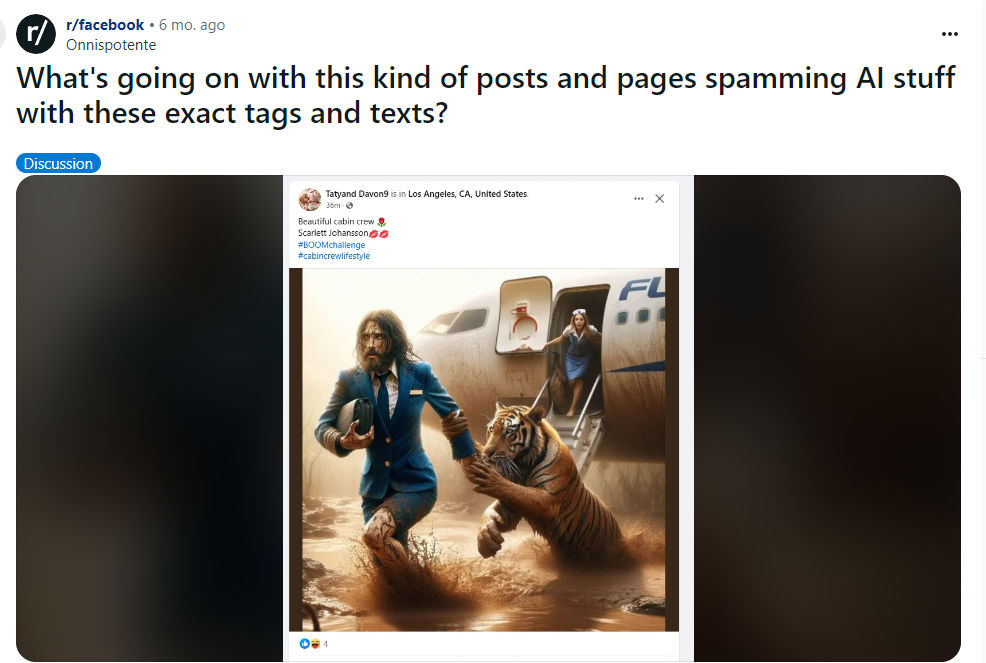

Geteilt auf r/facebook

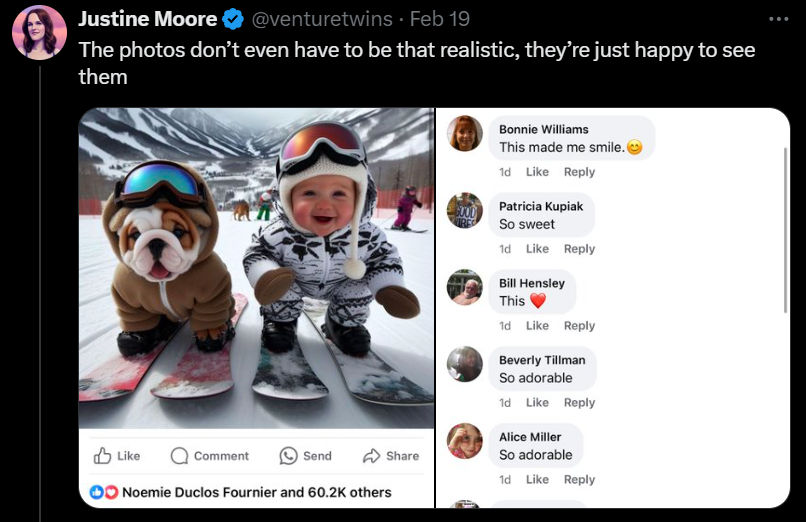

Wir haben auch Twitter (X) überprüft:

Bildquelle: @venturetwins

Dies sind nur einige Beispiele, aber es gibt viele weitere. Wir müssen wachsam bleiben und genau hinschauen, was wir online sehen, um nicht auf Betrügereien hereinzufallen.

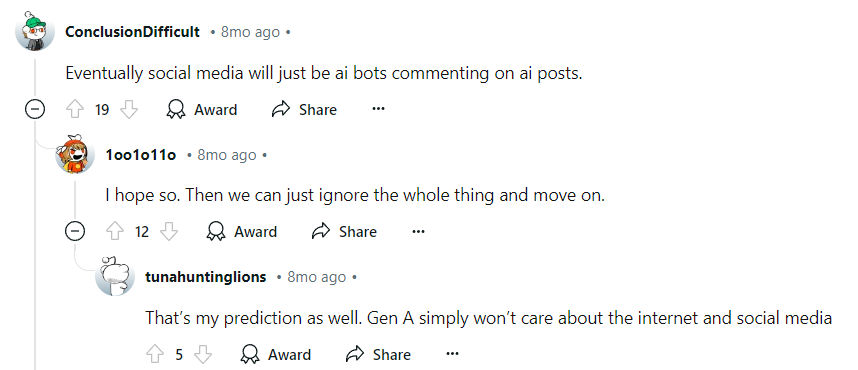

Die Folgen: Dead-Internet-Theorie

Laut diesem Artikel ist die „Dead-Internet-Theorie“ eine Verschwörungstheorie, die besagt, dass das Internet heute größtenteils aus Bot-Aktivitäten und automatisch generierten Inhalten besteht, die von Algorithmen manipuliert werden, um die Bevölkerung zu kontrollieren und die organische menschliche Interaktion zu reduzieren. Einige glauben, dass diese Bots absichtlich geschaffen wurden, um Algorithmen zu manipulieren und Suchergebnisse für kommerzielle oder politische Zwecke zu verbessern.

Auch wenn die meisten Menschen dieser Theorie nicht anhängen, fürchten einige Internetnutzer, dass sie wahr werden könnte, da KI und Bots jeden Tag präsenter werden.

Reddit-Nutzer diskutieren den Anstieg von Online-Bots.

Wie man KI-generierte Bilder erkennt: 5 Tipps für 2024

1. Zusätzliche Finger, Zehen oder Zähne

Eine der einfachsten Möglichkeiten, KI-generierte Bilder zu erkennen, besteht darin, Körperteile zu zählen. Viele KI-Bilder zeigen zusätzliche Finger, Zehen oder Zähne.

2. Verschwommene oder gemäldeartige Texturen

Plastilinartige Falten, scharfe Linien oder verschwommene Texturen sind oft klare Anzeichen für KI-generierte Inhalte.

3. Verformter Text

KI hat Schwierigkeiten mit Buchstaben. Wenn der Text verzerrt, verschwommen oder unsinnig erscheint, besteht eine hohe Wahrscheinlichkeit, dass das Bild KI-generiert ist.

4. Verschwommene Hintergründe

Dies ist besonders häufig auf Websites wie This Person Does Not Exist zu beobachten. Die Person auf dem Bild mag in Ordnung aussehen, aber der Hintergrund wirkt oft verschwommen oder vage und weist keine spezifischen Details auf.

5. Achten Sie auf Details

Auf den ersten Blick mag ein KI-Bild normal erscheinen. Aber bei genauerem Hinsehen könnten Accessoires, Ornamente oder Hintergründe verzerrt oder unnatürlich wirken. Wenn etwas seltsam aussieht, betrachten Sie wahrscheinlich ein KI-Bild.

Besorgt, dass Sie es mit einem gefälschten Bild zu tun haben?

Erkennen Sie gefälschte Bilder mit lenso.ai

Lenso ist ein KI-gestütztes Tool zur umgekehrten Bildsuche, das identische und ähnliche Bilder in Sekunden identifizieren kann und dabei hilft, KI-generierte Inhalte zu kennzeichnen.

So funktioniert es:

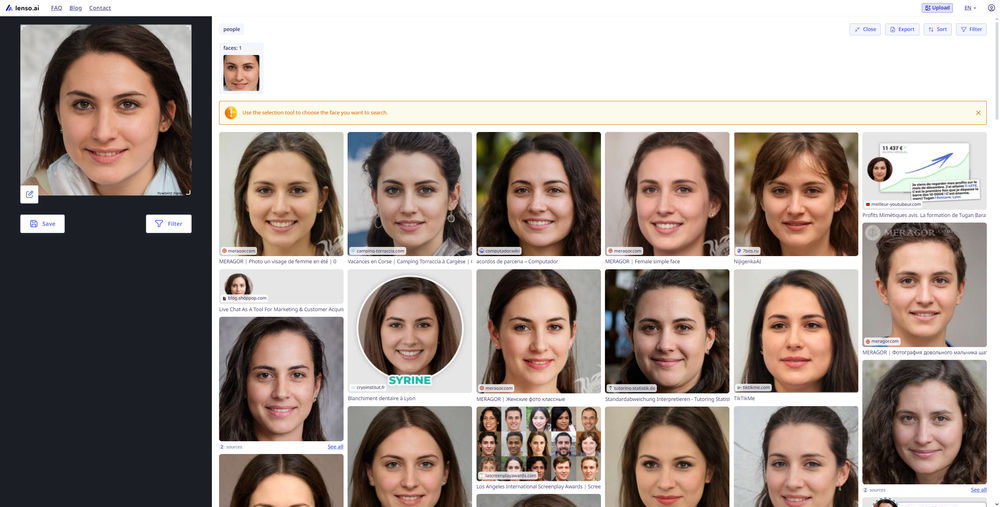

Gesichter

Wenn Sie ein Gesicht auf lenso.ai hochladen und es vage ähnliche Bilder von verschiedenen Personen zurückgibt, die alle KI-generiert aussehen, ist es wahrscheinlich, dass auch das ursprüngliche Bild KI-generiert ist.

Vermuten Sie, dass es KI ist? Testen Sie es:

- Laden Sie ein Bild von thispersondoesnotexist.com herunter, einer Website voller KI-generierter Bilder.

- Besuchen Sie lenso.ai und laden Sie das Bild auf der Startseite hoch.

- Die Ergebnisse sollten viele ähnliche Gesichter zeigen, alle KI-generiert.

Beispiele für andere KI-generierte Gesichter.

*Verfügbar in ausgewählten Regionen.

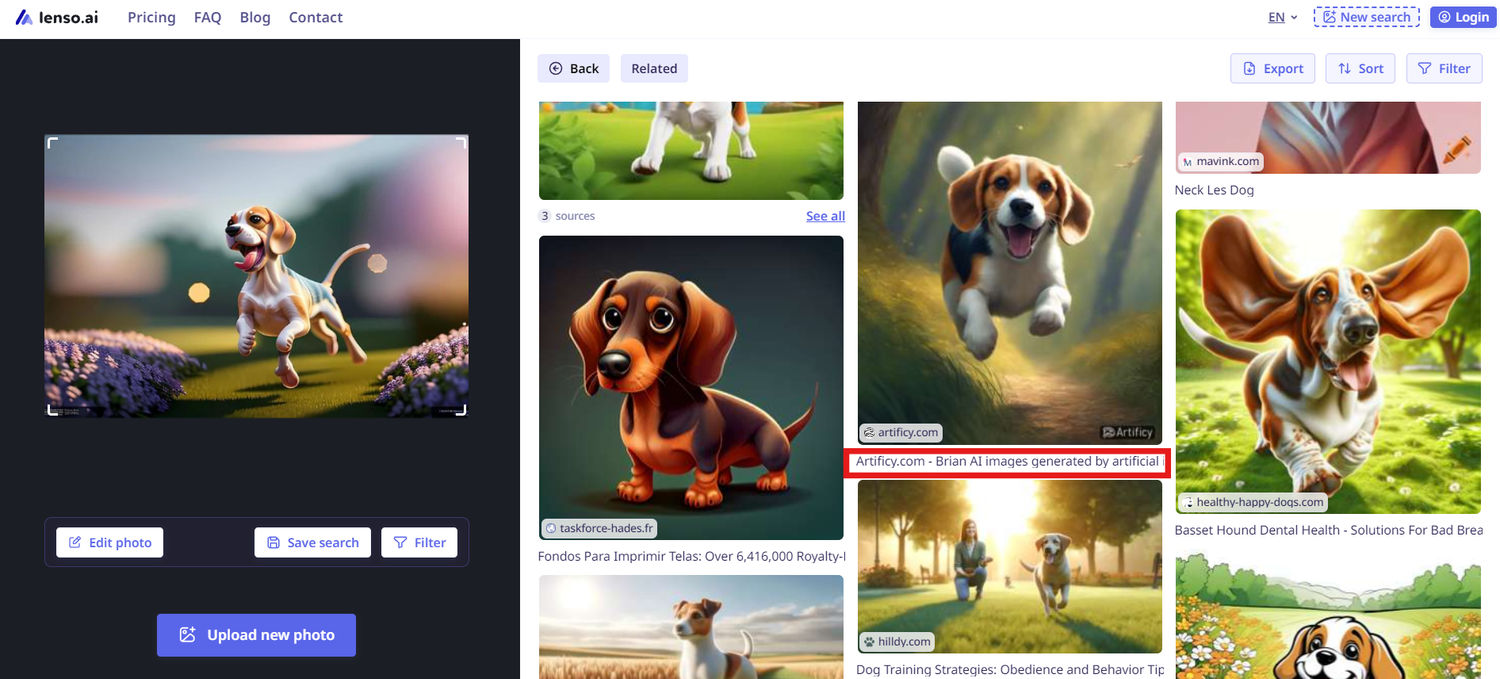

Kleidung, Gebäude und mehr

Die meisten KI-generierten Bilder liefern Ergebnisse von anderen KI-generierten Quellen. Um es zu testen, laden Sie einfach ein KI-erstelltes Bild hoch und überprüfen Sie die Quellen. Oftmals zeigen die Ergebnisse, dass das hochgeladene Bild ebenfalls KI-generiert ist.

Denken Sie daran: Diese Tipps funktionieren nicht immer, vertrauen Sie also Ihrem Instinkt, verwenden Sie gesunden Menschenverstand oder konsultieren Sie Online-Foren, wenn Sie unsicher sind, ob ein Bild KI-generiert ist.

Weiterlesen

Nachrichten

Die besten kostenlosen rückwärtigen Gesichtssuch-Tools im Jahr 2026

Finden Sie mehr Informationen über eine bestimmte Person nur mit einem Bild. Was ist das beste rückwärtige Gesichtssuch-Tool im Jahr 2026?

Nachrichten

Top 3 sichere Tools für die umgekehrte Bildersuche, um zu prüfen, ob deine Fotos auf Fake-Profilen verwendet werden

Hast du dich schon einmal gefragt, ob deine Bilder auf Fake-Profilen, Dating-Websites oder Online-Foren unter anderen Namen geteilt werden? Jetzt kannst du das überprüfen! Erfahre, wie du mit diesen Top 3 Websites für umgekehrte Bildersuche nach Bildern deines Gesichts suchen kannst, die ohne deine Zustimmung veröffentlicht wurden.

Nachrichten

Was ist die beste Gesichtssuchmaschine? Top 6 Webseiten

Wenn Sie eine Person anhand eines Bildes finden möchten, ist der einfachste Weg, eine Gesichtssuchmaschine zu verwenden. Gesichtserkennungstools sind eine relativ neue Technologie, aber es gibt einige Webseiten, die sich durch ihre Genauigkeit und Einfachheit auszeichnen. In diesem Artikel zeigen wir Ihnen unsere Top 6 besten Gesichtssuch-Tools, die tatsächlich funktionieren.

Nachrichten

Top 5 Websites für die Rückwärtssuche von Bildern zum Finden ähnlicher und verwandter Bilder

Manchmal sucht man bei der Bildersuche nicht nach einer exakten Übereinstimmung. Wenn du nach Inspiration, Designideen oder Teilen einer Fotosammlung suchst, brauchst du ein Tool, das nicht nur Duplikate erkennt, sondern Bilder findet, die miteinander verwandt sind oder eine ähnliche Komposition haben. Hier sind die Top 5 Websites für die Rückwärtssuche von Bildern, mit denen du Bilder mit ähnlicher Komposition, ähnlichem Stil oder Kontext entdecken kannst.

Nachrichten

Finde alles mit der Rückwärtssuche nach Bildern!

Gibt es einen einfacheren Weg, etwas online zu finden? Absolut, und er heißt Rückwärtssuche nach Bildern. Mit Tools für die Rückwärtssuche nach Bildern kannst du mühelos nach bestimmten Produkten, Orten oder Personen suchen – in nur wenigen Klicks. Erfahre, wie du die KI-basierte Rückwärtssuche nach Bildern in deinen Alltag integrieren kannst.