预览:

AI技术在过去几年中极大地发展,和其他创新一样,它应与公众和政府的接受度相匹配。这就是为什么制定和调整法规至关重要,这些法规将设定一些界限,同时不会成为开发者的障碍。

欧盟的人工智能法案是什么 ?

欧洲委员会在2021年发布了第一部法案,在其中解释了AI使用的基础和对可能出现的风险的责任。除此之外,还强调在欧洲联盟中将要(或已经)出现的任何AI技术都应当全面负责,并意识到社会影响,尊重在欧洲持久存在的价值观和规则。

多年来,该文件已多次更新,最后一次发布是在2023年。这种调整是不可避免的,因为AI技术仍在进行中。

因此,计划建立一个统一的AI法律门户网站,所有人都可以在那里检查最新的更新,并将其适配到自己的业务法规中。此外,还将提供发送关于AI系统误用并影响其数据的投诉的可能性。

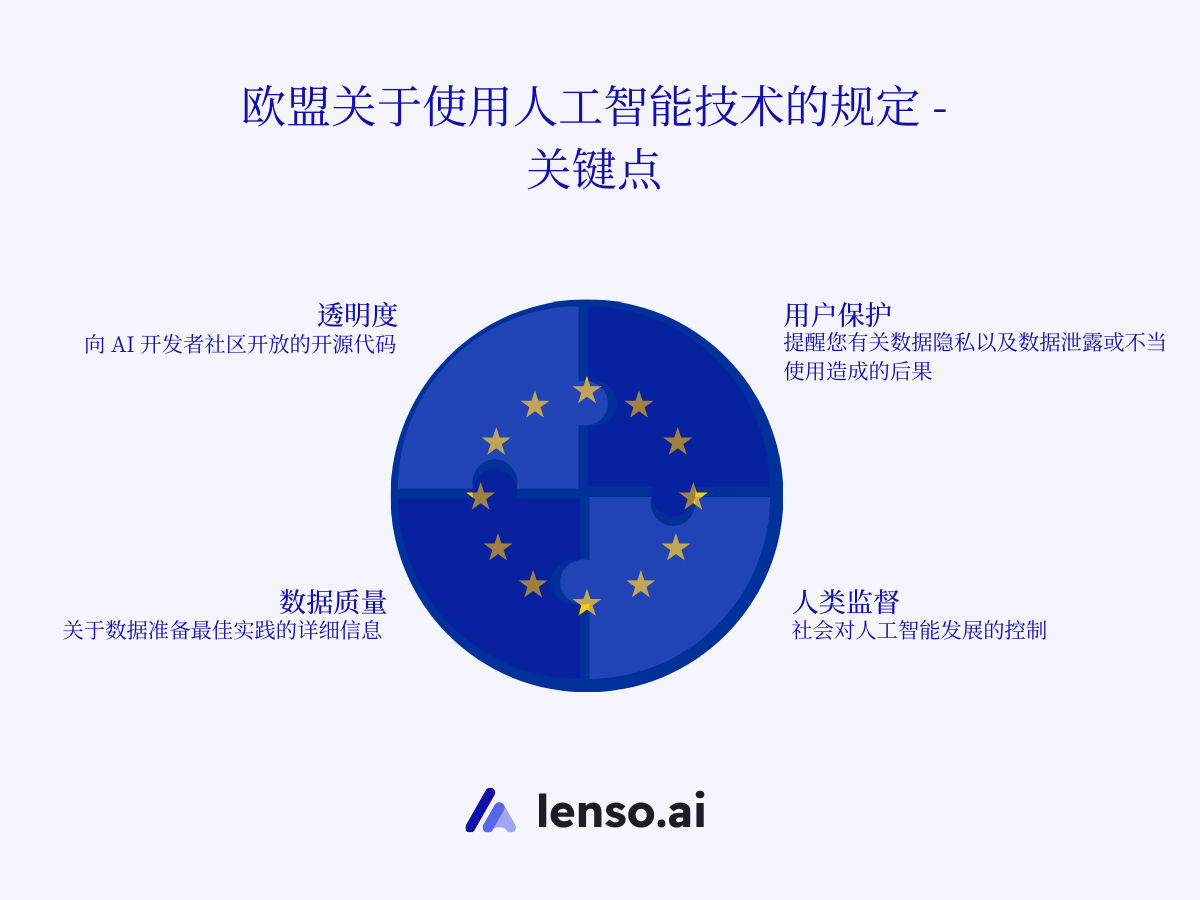

使用AI技术的欧盟法规 - 关键点

理论上,欧盟法规必须包括关于正确使用AI技术的详细说明,例如:

- 透明度:开源代码,供AI开发者社区使用

- 数据质量:关于数据准备的最佳实践的详细信息

- 用户保护:关于数据隐私泄露或不当使用的提醒

- 人类监督:社会对AI开发的控制

- 问责制:对行动和决策承担责任

文档还应揭示使用AI技术的四个风险等级:

- 不可接受:

- 对人或特定弱势群体的认知行为操纵

- 社会评分:基于行为、社会经济地位或个人特征对人进行分类

- 对人进行生物特征分类

- 高风险:

属于特定领域的AI系统,必须在欧盟数据库中注册:

- 关键基础设施的管理和运营

- 教育和职业培训

- 就业、工人管理和自主就业的准入

- 私人服务和公共服务及福利的获取和享受

- 执法

- 移民、庇护和边境控制管理

- 协助法律解释和适用

- 限制:

- 说明内容是由AI生成的

- 设计模型以防止其生成非法内容

- 发布用于培训的受版权保护数据的摘要

- 最低:

法律旨在为初创企业和中小企业提供开发和培训AI模型并将其发布给公众的机会。

此外,每个风险等级必须包含有关评估过程的具体信息/文档和好的实践示例,如:

- 严格测试

- 正确的文档记录

- 明确的商业目标

- 数据保护

此外,法规可能包含AI实施的详细指导(“应做和不应做”),这应符合欧盟原则法。

一旦法规进入最终阶段,欧盟委员会还计划对滥用AI技术或导致社会大规模威胁的公司/开发者征收费用。

接下来是什么?

首先,法规应在欧盟委员会中进行投票并获得接受。不幸的是,这样的辩论通常持续数月甚至数年。下一步包括在每个欧洲国家实施法规。

之后,公司/开发者将有两年时间更新他们的法规和服务以符合新标准。只有在另外六个月后,政府才会检查并禁止未申请新法律的AI服务。

为什么应该提供这样的法规?

首先,目前AI技术只是部分受到监管,仍有一些方面不受法律约束。从一个角度来看,这为开发者打开了一系列可能性。但不幸的是,在错误的手中,这种自由意志可能被用作武器。这可能会使整个数据保护过程面临风险。

除此之外,还应考虑以下声明:

- 基本人权保护 隐私、非歧视和自主权。

- 安全与可靠性:法规可以为AI系统的安全和可靠性建立标准和要求。

- 透明度与问责制 要求解释AI决策过程,披露数据来源和培训方法,并为AI相关结果分配责任。

- 伦理考虑 AI引发各种伦理问题,包括与公平、偏见、问责制以及对工作和社会的影响相关的问题。

- 促进创新和竞争力 清晰一致的法规可以为企业和消费者提供确定性和信心。它还可以帮助确保在欧盟市场经营的企业具有公平的竞争环境。

- 全球领导 通过制定和实施严格的AI法规,欧盟可以将自己定位为负责任的AI治理的全球领导者。